SQLITE NOT INSTALLED

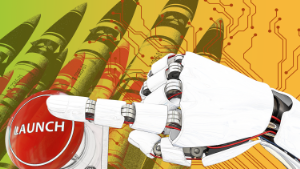

В недавно опубликованном исследовании корпорации RAND сделан вывод, что к 2040 году искусственный интеллект (ИИ) может радикально изменить концепцию ядерного сдерживания.

«Машина судного дня» под управлением ИИ пока представляется маловероятной, но реальные риски ИИ для ядерной безопасности заключаются в способности ИИ побудить людей к принятию неоправданных, потенциально апокалипсических решений.

Во времена Холодной войны концепция гарантированного взаимного уничтожения поддерживала шаткий мир между супердержавами, утверждая, что любая атака приведёт к разрушительному возмездию. В итоге концепция ГВУ обеспечивала стратегическую стабильность, отрезвляюще действуя на обе стороны в их готовности к действиям, реально способным перерасти в атомную войну.

В публикации RAND говорится, что в ближайшие десятилетия ИИ вполне способен разрушить концепцию гарантированного взаимного уничтожения и тем самым подорвать стратегическую стабильность нашего мира. Более совершенные датчики делают вероятной ситуацию, когда «орудие возмездия» — например, атомная субмарина и мобильные ракеты, — могут быть опознаны и уничтожены.

Нации могут войти в соблазн стремиться к обладанию средствами первого удара, как если бы это давало преимущества над соперниками, даже если у них нет намерения нанести удар первыми. Это подрывает стабильность тем, что если даже сторона, способная атаковать первой, не собирается использовать эту возможность, её противник не может быть уверен в этом.

«Связь между ядерной войной и ИИ не нова, в действительности их истории переплетаются, — говорит Эдвард Гайст, соавтор статьи и сотрудник корпорации RAND. — Изначально существенная часть исследований в области ИИ выполнялась с поддержкой военных, преследуя их цели».

Как пример он привел «адаптивный планируемый эксперимент выживаемости», проведённый в 1980-х, целью которого было использовать ИИ для объединения разведданных с целеуказанием для средств ядерного поражения.

В случае неопределённости ИИ мог бы укрепить стабильность стратегической ситуации, улучшив точность собираемых разведданных и их анализ.

Исследователи полагают, что в процессе развития ИИ станет менее подвержен совершению ошибок по сравнению с людьми, а значит окажется фактором стабильности в долгосрочном плане.